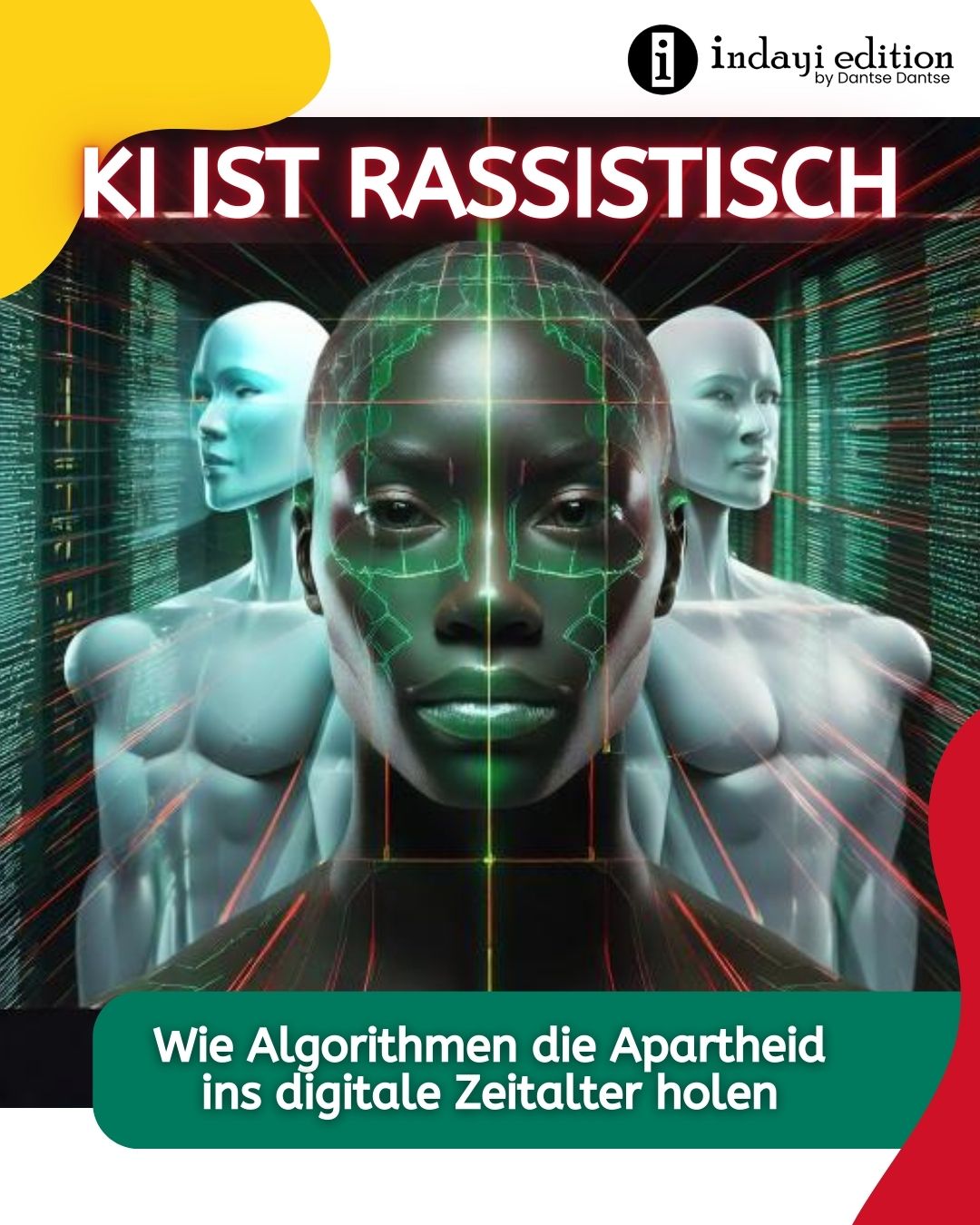

KI ist rassistisch: Wie Algorithmen die Apartheid ins digitale Zeitalter holen - indayi edition

Künstliche Intelligenz (KI) ist rassistisch! Sie gilt als revolutionär, doch sie trägt ein dunkles Geheimnis in sich. KI ist rassistisch, weil sie bestehende diskriminierende Strukturen verstärkt und dafür sorgt, dass Schwarze Menschen systematisch benachteiligt werden, während weiße Menschen bevorzugt werden. Ob in der Gesichtserkennung, im Justizsystem oder im Gesundheitswesen–KI ist rassistisch und entwickelt sich zum digitalen Werkzeug der Unterdrückung. Dieser Artikel deckt auf, wie tief verwurzelt diese Problematik ist und warum wir sofort handeln müssen!

(IINews) - Die digitale Apartheid durch Algorithmen

KI ist rassistisch und dient als perfektes Werkzeug für moderne Segregation. Gesichtserkennungstechnologien diskriminieren Schwarze massiv. Während weiße Gesichter fehlerfrei erkannt werden, stuft KI Schwarze falsch ein oder verwechselt sie mit Kriminellen. Studien belegen: Amazon, Microsoft und IBM haben Systeme entwickelt, die schwarze Frauen mit einer Fehlerquote von bis zu 34 % falsch klassifizieren, während weiße Männer fast perfekt erkannt werden.

Doch die Diskriminierung endet nicht bei der Gesichtserkennung. KI ist rassistisch, wenn sie Bewerbungssoftware dazu bringt, schwarze Kandidaten systematisch schlechter als weiße zu bewerten. Amazon musste 2018 sein eigenes KI-Rekrutierungssystem zurückziehen, weil es Frauen und ethnische Minderheiten diskriminierte. Diese Algorithmen übernehmen die Ungerechtigkeiten der Vergangenheit und übertragen sie in die digitale Zukunft!

Google Translate zeigt ebenfalls, dass KI rassistisch ist. Neutrale Sätze werden verzerrt, und Schwarze werden oft mit negativen Begriffen assoziiert. Diese Verzerrungen beeinflussen unbemerkt unseren Alltag und zementieren bestehende Vorurteile.

Algorithmische Unterdrückung im Justizsystem

KI ist rassistisch und kriminalisiert Schwarze unverhältnismäßig oft. „Predictive Policing“ sorgt dafür, dass Polizeipräsenz in schwarzen Vierteln verstärkt wird, weil frühere Verhaftungen – oft rassistisch motiviert – als Grundlage für neue Einsätze dienen. Ein endloser Kreislauf digitaler Unterdrückung! Das System COMPAS zeigt ebenfalls: Schwarze erhalten höhere Risikobewertungen als weiße Täter mit denselben Vergehen. So entsteht eine digitale Zweiklassengesellschaft, in der Ungerechtigkeit per Algorithmus programmiert wird.

Tödliche Diskriminierung im Gesundheitswesen

KI ist rassistisch und kann tödlich sein! In US-Krankenhäusern entschied ein Algorithmus, welche Patienten dringend Hilfe benötigen. Weiße Patienten wurden bevorzugt, weil die KI sich an historischen Daten orientierte, die Schwarze in der medizinischen Versorgung benachteiligten. Dies führte dazu, dass Schwarze weniger Behandlung erhielten – eine Form digitaler Eugenik!

Auch in der Hautkrebsdiagnose zeigt sich: KI ist rassistisch! Algorithmen sindüberwiegend mit Bildern weißer Haut trainiert, weshalb schwarze Hautkrebsfälle oft übersehen werden. Das bedeutet für viele Schwarze eine geringere Überlebenschance – mit fatalen Folgen!

Wer trägt die Verantwortung?

Warum geschieht das? KI ist rassistisch, weil die Entwickler dieser Systeme meist weiß sind und unbewusst oder bewusst ihre eigenen Vorurteile in die Technologie einfließen lassen. Diese Machtverhältnisse werden nicht hinterfragt, sondern von den Algorithmen weiter manifestiert.

Was kann getan werden?

Mehr Diversität in der Entwicklung: Schwarze Programmierer müssen an der Gestaltung von KI beteiligt sein.

Transparenz und Kontrolle: Algorithmen müssen offengelegt und auf Diskriminierung überprüft werden.

Neue Datensätze: KI muss mit vielfältigen, gerechten Daten trainiert werden.

Gesetze und Regulierung: Diskriminierende KI muss verboten und Entwickler zur Verantwortung gezogen werden.

Öffentliche Aufklärung: Proteste und Bewusstseinsbildung sind notwendig, um Veränderung zu erzwingen!

KI ist rassistisch– wir müssen JETZT handeln!

KI ist rassistisch und eine direkte Bedrohung für Schwarze Menschen weltweit, wenn wir nicht eingreifen. Wer schweigt, unterstützt digitale Apartheid! Es reicht nicht, höflich zu bleiben – wir müssen laut sein, protestieren und handeln, bevor es zu spät ist. Die Technologie wird nicht von selbst gerechter – es liegt an uns, sie in die richtige Richtung zu lenken!

Themen in diesem Fachartikel:

Unternehmensinformation / Kurzprofil:

indayi edition ist ein aufstrebender, kleiner, bunter, außergewöhnlicher Verlag in Darmstadt, der erste deutschsprachige Verlag, der von einem afrikanischen Migranten in Deutschland gegründet wurde. Wir schreiben und veröffentlichen alles, was Menschen betrifft, berührt und bewegt, unabhängig von kulturellem Hintergrund und Herkunft. Wir schreibenüber Werte undüber Themen, die die Gesellschaft nicht gerne anspricht und am liebsten unter den Teppich kehrt, unter denen aber Millionen von Menschen leiden. Wir schreiben und publizieren Bücher, die das Ziel haben, etwas zu erklären, zu verändern und zu verbessern–seien es unsere Ratgeber, Sachbücher, Romane oder Kinderbücher. Unser Angebot ist vielfältig: Wir veröffentlichen unter anderem Ratgeber zu den Themen Gesundheit und Ernährung, Erziehung, Erotik, Liebe, psychologische Selbsthilfebücher und spannende Thriller und Krimis und Bücherüber Politik, Kultur, Gesellschaft und Geschichte, Kochbücher sowie Kinder- und Jugendbücher.

indayi edition

info(at)indayi.de

Diltheyweg 5

64287 Darmstadt

indayi edition

info(at)indayi.de

Diltheyweg 5

64287 Darmstadt

Datum: 17.02.2025 - 12:42 Uhr

Sprache: Deutsch

News-ID 2152735

Anzahl Zeichen: 0

Kontakt-Informationen:

Stadt:

Darmstadt

Kategorie:

Politik & Gesellschaft

Meldungsart: bitte

Versandart: Veröffentlichung

Dieser Fachartikel wurde bisher 35 mal aufgerufen.

Der Fachartikel mit dem Titel:

"KI ist rassistisch: Wie Algorithmen die Apartheid ins digitale Zeitalter holen - indayi edition"

steht unter der journalistisch-redaktionellen Verantwortung von

indayi edition (Nachricht senden)

Beachten Sie bitte die weiteren Informationen zum Haftungsauschluß (gemäß TMG - TeleMedianGesetz) und dem Datenschutz (gemäß der DSGVO).